# Word Embedding

- 각 단어를 좌표공간에 최적의 벡터로 표현(embedding)하는 기법

- 각 단어들을 특정한 차원으로 이루어진 공간 상의 한 점, 혹은 그 점의 좌표를 나타내는 벡터로 변환해주는 기법

- 워드 임베딩은 그 자체가 머신러닝 혹은 딥러닝 기술

- text 데이터셋을 학습 데이터로 주고 좌표 공간의 차원 수를 사전에 정의한 후 입력으로 워드 임베딩 알고리즘을 주면 워드 임베딩 학습이 완료된 이후 해당하는 좌표 공간 상에서 학습 데이터에서 나타난 각각의 단어에 대한 최적의 좌표값 혹은 그에 해당하는 벡터 표현형을 출력함

- 비슷한 의미를 가지는 단어가 좌표 공간 상에 비슷한 위치의 점으로 매핑되도록 함으로써 단어들의 의미상 유사도를 잘 반영한 벡터 표현을 다양한 자연어 처리 알고리즘에게 제공

# Word2Vec

- 워드 임베딩 학습 방법 중 하나

- 같은 문장에서 나타난 인접한 단어들간의 의미가 비슷할 것이라는 가정을 사용

- 한 단어의 의미를 주변에 등장하는 단어들을 통해 알 수 있음에서 착안함

=> 주어진 학습 데이터를 바탕으로 cat 주변 단어들의 확률 분포를 예측

=> cat 단어를 입력으로 주고 주변 단어를 숨긴채 이를 예측하도록 하는 방식으로 Word2Vec 모델의 학습이 진행됨

- Word2Vec 모델 구조 및 학습 방식

- 주어진 학습 데이터를 word별로 분리하는 tokenization 과정 수행

- unique한 단어만 모아서 사전(vocabulary) 구축

- 사전의 각 단어는 사전의 사이즈만큼의 dimension을 가지는 one-hot-vector로 표현됨

- sliding window라는 기법을 적용해서 한 단어를 중심으로 앞뒤로 나타난 word 각각과 입출력 단어쌍을 구성

- sliding window = 일정한 범위(window)를 가지고 있는 것을 유지하면서 이것을 이동(sliding)하는 알고리즘

- window 사이즈 = 3 => 앞뒤로 한 단어씩 봄

- hidden layer의 노드 수 = 사용자가 정함 => 워드 임베딩을 수행하는 좌표 공간의 차원 수와 동일한 값으로 설정

- 원-핫 벡터와 첫번째 선형변환(matrix)이 곱해지는 과정 = embedding layer

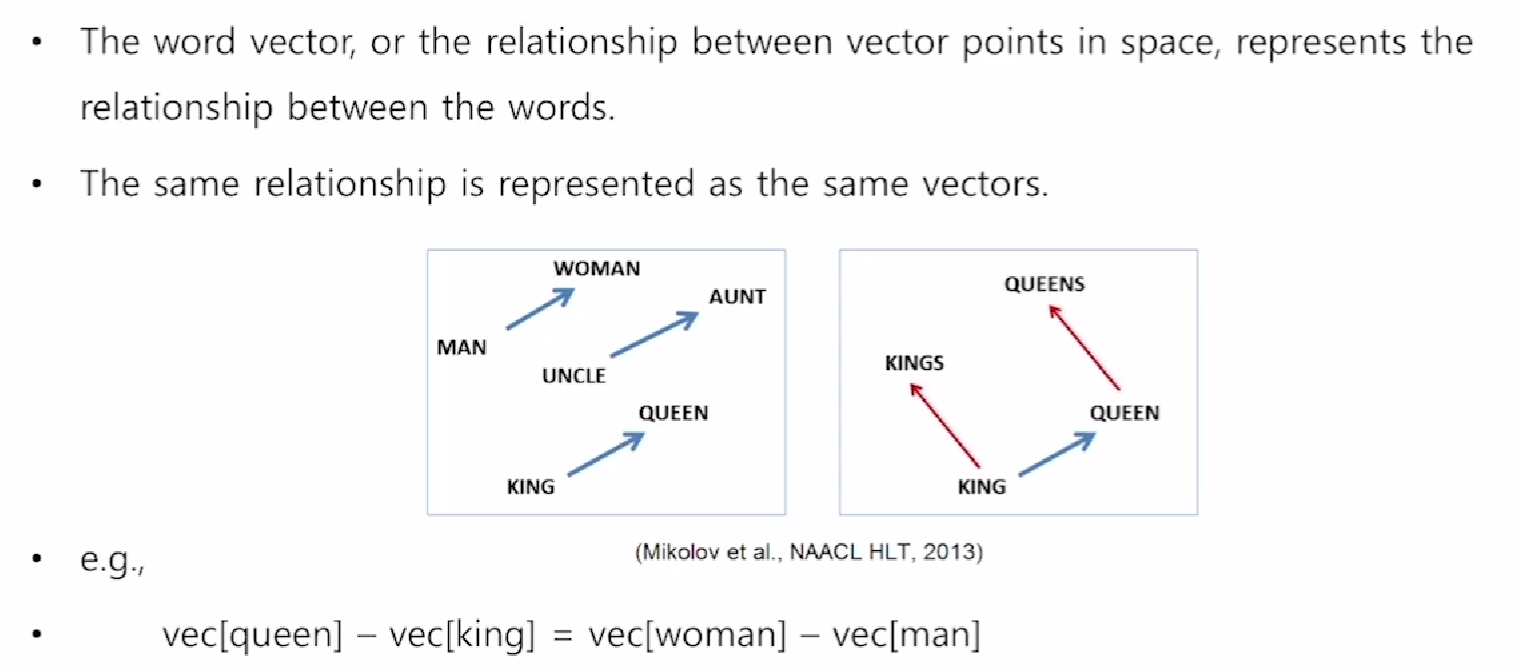

- 워드들간의 의미론적 관계를 벡터 임베딩 결과에 잘 학습함

- Intrusion Detection

- 나머지 단어와 의미가 가장 상이한 단어 찾아낼 수 있음

# GloVe(Global Vectors for Word Representation)

- 각 입력 및 출력 단어쌍들에 대해서 학습 데이터에서 두 단어가 한 window 내에서 총 몇 번 동시에 등장했는지를 사전에 미리 계산하고 단어간의 내적된 값과 미리 계산된 값의 차이를 줄여나감

=> Glove는 Word2Vec과 다르게 사전에 미리 각 단어들의 동시 등장 빈도수를 계산하며, 단어간의 내적값과 사전에 계산된 값의 차이를 줄여가는 형태로 학습합니다. - GloVe는 사전에 계산된 Ground Truth를 사용해 반복 계산이 줄어들어 Word2Vec에 비해 학습이 더 빠르게 진행되고 더 적은 데이터에서도 잘 동작함

# 참고글

자연어 처리의 모든 것

부스트코스 무료 강의

www.boostcourse.org

[Algorithm] 슬라이딩 윈도우(Sliding Window) 알고리즘

슬라이딩 윈도우 알고리즘 슬라이딩 윈도우 알고리즘은 윈도우 즉 일정한 범위를 가지고 있는 것을 유지하면서 이것을 이동(sliding) 하는 것이다. 예를들어 2가지 긴 문자열이 주어지고 알파벳 2

ramees.tistory.com

'딥러닝' 카테고리의 다른 글

| [개념] RNN, 시퀀스-투-시퀀스 (0) | 2023.02.09 |

|---|---|

| [개념] Bag-of-Words, Naive Bayes Classifier (0) | 2023.02.09 |

| [개념] 딥러닝 학습 방법 이해하기 (0) | 2023.01.31 |

| [개념] 한국어 전처리 패키지(Text Preprocessing Tools for Korean Text) (0) | 2023.01.25 |

| [개념] 어간 추출(Stemming) 및 표제어 추출(Lemmatization) (0) | 2023.01.22 |